本篇文章主要内容是用PHP多个进程配合redis的有序集合实现大文件去重,感兴趣的朋友可以学习一下。

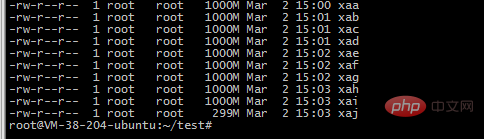

1.对一个大文件比如我的文件为

-rw-r–r– 1 ubuntu ubuntu 9.1G Mar 1 17:53 2018-12-awk-uniq.txt

2.使用split命令切割成10个小文件

split -b 1000m 2018-12-awk-uniq.txt -b 按照字节切割 , 支持单位m和k

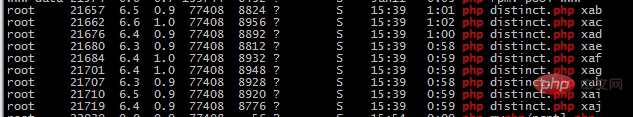

3.使用10个php进程读取文件 , 插入redis的有序集合结构中 , 重复的是插不进去的 ,因此可以起到去重的作用

<?php$file=$argv[1];//守护进程umask(0); //把文件掩码清0if (pcntl_fork() != 0){ //是父进程,父进程退出 exit();} posix_setsid();//设置新会话组长,脱离终端if (pcntl_fork() != 0){ //是第一子进程,结束第一子进程 exit();} $start=memory_get_usage();$redis=new Redis();$redis->connect('127.0.0.1', 6379);$handle = fopen("./{$file}", 'rb');while (feof($handle)===false) { $line=fgets($handle); $email=str_replace("\n","",$line); $redis->zAdd('emails', 1, $email);}

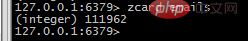

4. redis中查看获取的数据

zcard emails 获取元素个数

取一定范围的元素 , 比如从100000开始 到 100100结束

zrange emails 100000 100100 WITHSCORES

想更高效学习PHP,请关注PHP中文网的PHP视频教程。

以上就是PHP结合redis实现大文件去重的详细内容,更多请关注求知技术网其它相关文章!